WB3交流加微信:WX-93588,⬅️此处为全站广告位,与正文项目无关

注册并登录App即可领取高达 60,000 元的数字货币盲盒:点击此处注册OKX

“一种依据文本指令创建绘图的算法” -MidJourney

你现在看到的是文字——文字作为一种前言,让我向你传达一连串的主意。自从人类用文字记载事物,而不再依靠记忆,咱们就一直在运用一连串符号来传递信息,你能够把所有这些称为“文本”。

今时今天,以及在曩昔的几个世纪里,咱们现已将咱们对国际的常识、咱们的主意、咱们的幻想转化为文字。也便是说,人类的大部分常识现在都以文字的方式存在,咱们也在用其他方法沟通,比如肢体言语、图画、声响等。但文字是咱们用于记载沟通、思想和观念的最丰厚的前言,由于运用起来十分便当。

当GPT-3被输入互联网信息时,它消化了咱们对周围国际的调查、咱们的无聊世事、咱们彼此之间疯狂的争辩……,学会了在一连串符号化的人类紊乱表达中猜测下面的内容。

在学习咱们连词成句进行沟通的过程中,一个大型的言语模型会模仿(或“鹦鹉学舌”)咱们怎样恶作剧、安慰和发布指令。GPT-3敞开了一场“革新”,在 “从文本到文本”方面体现得十分好:输入一些使命例子(如完成一个比喻)或对话开头,这个生成模型(通常)就能够学习使命或继续对话。

咱们在文字的运用方法中,几乎存在一定的“普遍性”,而咱们的技术仅仅在最近才到达这样的程度:人工智能体系能够加以整合,开掘咱们运用言语的方法,从而描绘其他形状。完成强壮文本生成才能的技术,也能用以完成文本条件下的多形状生成。“从文本到文本”变成了“从文本到X”。

在“从文本到文本”中,你能够要求模型对一只狗进行描绘。在“从文本到图画”中,你能够将该描绘转化为其对应的视觉效果。文本-图画模型供给了一种现有图画生成体系所不具备的新才能。现有的模型,例如GANs,经过练习,能够在给定的噪声输入下(以及用于类别条件图画生成的类别信息)生成实在的图画。但这些模型的可控水平不高,难以到达 DALL-E 2、Imagen 等模型的高度:用户能够要求生成一只戴着太阳镜的袋鼠,站在特定的建筑物前,拿着带有特定短语的牌子。你的愿望便是算法的指令。

谷歌 Parti 生成的图片

在“文本到图画”得以有用完成之后,更多的运用随之而来:“文本到视频”是下一个热点。“文本到音频”技术现已存在。“文本到动图”和“文本到3D”技术说明了文字能够转化为其他事物。

这篇文章的主题是“从文本到全部”的一年。最近的技术开展,使人们能够以更有用的方法快速地将文本转换为其他形状。这些开展令人兴奋的,并有望在未来几年内完成许多的运用和产品。可是咱们也应该记住,“文本的国际”是有局限性的,仅仅一些空洞的考虑,描绘国际却不与其发生实践互动。我将讨论时至今天的技术进步,也会考虑假如文本信息的“呈现”仅仅停留在文本范畴,“从文本到全部”会有怎样的局限性。

多形状终于成为实际

从技术上说,GPT-3揭开了全部的序幕。这现已被说到许多次了,所以我就简略说一下:OpenAI练习了依据transformer架构的大言语模型。这个模型比之前的GPT-2大得多,练习的数据也多得多(1750亿个参数vs 15亿个参数;40TB的数据vs 40GB),OpenAI其时以为发布这个模型太危险了。它能够做一些工作,比如编写不那么杂乱的JavaScript代码。有些人会觉得很酷,有些人会觉得一点也不酷,有些人会觉得一般般。创业公司都建立在新的最大的模型上,新闻和学术文章都在赞扬和批评新模型,美国以外的国家也在开展自己的大言语模型参与竞争。

2021年1月,OpenAI 推出了一个名为CLIP的新人工智能模型,它拥有与GPT-3相似的zero-shot才能。CLIP向衔接文本和其他形状迈出了一步,它提出了一种简略、高雅的办法来练习图画和文本模型,当有人进行查询时,整个体系能够在可能的标题挑选中,把图画与相应的标题相匹配。

DALL-E可能是第一个“善于”从文本发生图画的体系,与CLIP在同一天发布。CLIP在第一代DALL-E中没有运用,但在这以后续版别中发挥了重要作用。由于能够依据文字提示生成合理的图画,DALL-E上了多个新闻头条。

分散模型(diffusion model)登场

虽然一些人工智能先驱感叹,假如咱们想完成“真实的”通用智能,深度学习不是办法,但“文本到图画”模型无疑合适运用深度神经网络的力气。深度学习模型中的一些互补性开展,使得“文本到图画”模型取得了进一步的飞跃:分散模型被发现,完成了极高的生成图画质量。(拜见论文Diffusion Models Beat GANs on Image Synthesis)。

DALL-E 2的发布时间间隔DALL-E约一年多,运用分散模型的技术进步,创造出比DALL-E更传神的图画。而DALL-E 2的风头很快就被Imagen和Parti抢去——前者运用分散模型展现了冷艳的水准,后者则探究出了一种弥补性的自回归办法来生成图画。

故事并没有到此完毕。Midjourney是一个用于图画生成的商业分散模型,由同名实验室发布。安稳分散(Stable Diffusion)模型借鉴了对潜在分散模型的新研讨,能够用有限的核算资源进行练习,由于Stability AI公司挑选公开该模型及其权重,Stable Diffusion的发布受到了万众瞩目。

神经网络架构的立异并不是促成以上改善的仅有原因。yahoo在2015年发布了Yahoo Flickr Creative Commons 100 Million Dataset(YFCC100M),在其时是有史以来最大的公共多媒体数据集合。最近,Large-scale Artificial Intelligence Open Network(LAION)发布的数据集更在规模上令YFCC100M黯然失色。2021年发布的LAION-400M包括4亿个图画-文本对,然后是2022年发布的LAION-5B包括50亿个图画-文本对。

值得注意的是,虽然这些数据集能够大规模地练习图画-文本模型,但它们并非没有问题。The Decoder的陈述曾发现LAION的数据集包括未经同意发布的患者图画,研讨人员也评论说,该数据集的质量并不纯粹。如此巨大的数据集必然会有其他的伦理问题呈现,OpenReview上的作者和审稿人好像就这些问题进行了颇有见地的意见沟通。

从文本到全部!

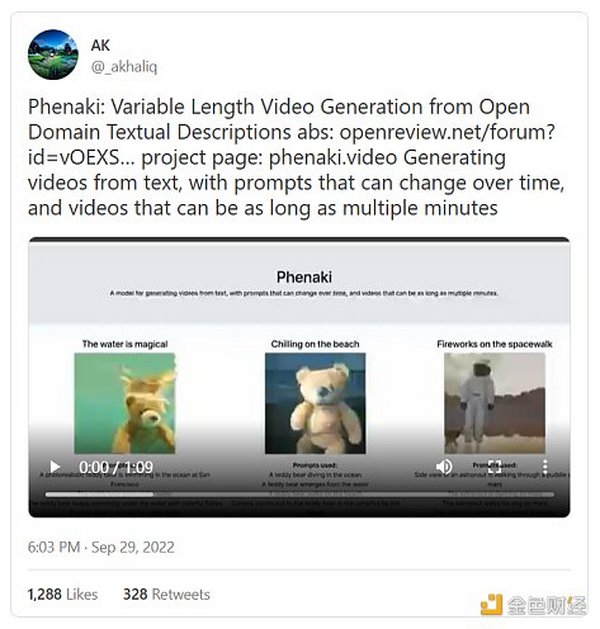

假如人工智能模型能够将文本转换为图画,那么它们能够将文本转换为视频吗?当然能够!10月份,一批从文本到视频的生成软件面市。Meta公司的Make-a-Video能够依据文本和静止图画生成视频,而谷歌大脑的Phenaki能够依据一系列构成故事的提示词生成一个接连视频。

或许更有用,或者说更令人担忧的是,这些生成模型也能担任代码的编写。当用户注意到GPT-3能够写出像样的代码时,GPT-3开始登上新闻头条,声名鹊起。从那时起,代码生成言语模型的才能有了很大的进步。OpenAI的Codex能将自然言语转化为代码,并且许多其他相似的模型也在纷纷效仿。DeepMind的AlphaCode也能以合理的水平处理编程问题。

这些技术进步彼此追赶的速度令人印象深入,正如Kevin Roose等人所评论的那样:“AI的开展速度如此惊人,怎样着重都不为过。我刚写完一篇关于AI惊人开展速度的文章,市场上就有了一些严重发布,包括OpenAI的Whisper(语音到文字的转录软件)和文字到视频的生成软件。”

并且AI还能够更进一步:文本也能够转化为其他前言,包括音频、动作和3D。

并且,正如咱们的同伴Jacky Liang博士所展现的,言语模型乃至能够依据自然言语指令编写机器人政策代码。

看起来生成式AI的可能性是无穷无尽的。咱们仅仅看到了人工智能模型创造力的雏形。我估计,跟着越来越强壮的模型开宣布来,文本将能够辅导许多的发明立异。红杉资本最近发布的《生成式AI运用格局》,现已展现了许多不同的细分赛道。

在一个特定的生成赛道内,有许多可能性和商业范畴能够运用这种类型的生成东西。文本生成不只能够承当文章的写作,还能够承当平台的后期言语调整;图画生成和文本转3D东西能够为游戏、信息运用和市场营销创造各种工艺品;其他运用供给了生成文档的才能。并且,正如上图所指出的,音乐、音频和生物/化学方面的运用还没有到来。

ChatGPT和更多的“文字到文字”

即使是在“文本到文本”范畴,也有海量的工作能够做:最近推出的ChatGPT在互联网上炸开了锅,基本上是由于该模型有才能以对话的方式全面答复问题。你能够要求它为你拟定一个简略的练习计划,写一个课程纲要,主张你做什么,向你某位哲学家的著作,以及其他许多工作。

不行值得注意的是,ChatGPT的常识有严重的局限性。

事实上,假如你要求ChatGPT供给关于某个特定主题的更多细节(例如普鲁斯特关于时间性质的主意),它就会开始自己绕圈子——挺契合你对一篇高中生作文的希望。事实上,ChatGPT的存在可能会改变咱们对写作技巧的某些方面的理解。

> 或许有理由感到乐观,假如你把这全部放在一边。或许每个学生现在都能立即进入更高的写作层次,每个学生都能够直接进入写作工作的更精密的方面,任何难以模仿的东西都将变得更显着。逗号衔接、主谓不一致、冗长的修饰语等令人头痛的机械性问题都不复存在,写作的根底技术现已直接给定了。

正如我所说到的,ChatGPT好像还只能对它所论述的主题作比较浅层次的描绘,无法太深入。它能够写得足够流通,并给你一些所需求的细节,但假如你能供给它所缺少的深入分析和深入理解,它就还不能替代你的工作。

文天性逾越自己吗?

通过在多模态数据集上练习模型,咱们能够理解文字、言语中编码的信息怎样映射到图画、三维图画和咱们周围国际的其他体现方式。“文本到图画”标明,生成的图画能够反映准确的文字描绘。可是生成式AI还不能做到尽善尽美,Stable Diffusion模型在其生成的图画中显着存在着赋予人类正确手指数量的问题。

但值得注意的是,在“文本到图画”体系中,仅仅通过扩展言语模型就能完成改善。Imagen运用仅在文本上练习的T5编码器(110亿个参数),发生的图画比DALL-E 2更传神,后者的文本编码器已被练习为发生相似于匹配图画嵌入的文本嵌入。

也便是说,将文本转化为其他模态的可能性(咱们能够做什么,以及咱们用目前的办法能走多远)并不显着。对那些看到真实开展限制的观点,我感同身受:尽管“文本到图画”数据集能够告诉咱们这个国际的许多现象,但它们不存在于物质国际中,缺少像咱们相同能够与物体、与其他人类互动的才能,并通过互动从周围国际中搜集视觉和非视觉信息。

可是显然,有许多工作能够做。谷歌最近的RT-1(变形机器人)展现了怎样运用自然言语来处理机器人使命。

“ChatGPT能够为你策划一场主题派对,但它能帮你在派对完毕后清扫屋子吗?很可惜不能。我在谷歌机器人的朋友刚刚公布了RT-1,一款带有眼睛、手臂和轮子的变形机器人!”

正如Franois Chollet在一次采访中向我指出的那样,在“文本到图画”这个范畴,神经网络的才能能够大放异彩。我也对潜在的二级运用场景感到兴奋,比如在文本辅导下的分子规划和其他并不清楚明了的构思。

然而,我以为要真实开掘“文本到X”模型的潜能,着实需求有更好的界面:咱们需求以更好的方法,向模型表达咱们的意思、概念和主意。提示工程作为一门学科呈现,能够反映出咱们目前与GPT-3等模型的沟通方法是低效的。

展望未来,我以为在咱们使“文本到全部”成为实际的过程中,咱们需求处理两个驱动开展的问题:

1. 咱们怎样构建界面,使咱们能够更好地将咱们的目的传达给AI模型?

2. 这些模型能够为咱们带来哪些有用的生成成果或举动?

可是在实践问题之外,我以为另一个问题更有意思:文本到{文本、图画、视频等}的模型并不完美,但十分好用。在将主意以图画或视频的方式呈现出来这一方面,这些模型远比普通人,乃至是本身颇有艺术造就的人类要好得多。正如Daniel Herman关于ChatGPT提出的问题:对从事艺术、从事视频制造而言,文本到全部意味着什么?咱们是否会进入这样一个时期:艺术的根底常识变得愈加商品化,任何人都能够通过不同的前言,以更精密的艺术方法传递自己的思想?在那里,水彩画的技巧被简化为提示中的文字,剩余的便是人类和AI体系之间的共舞互动?

一如既往,咱们不应该夸张这些AI体系的才能——它们经常会呈现清楚明了的过错。可是,当遇到正确的问题时,AI能够体现得很超卓,为人类供给更多空间去做更风趣的工作,并追寻写作、艺术的更高层次。

并且,除了这些直接的运用之外,“文本到X”模型及其根底技术还有哪些尚待探究的进一步运用?研讨人员现已在考虑怎样运用NLP模型来猜测蛋白质的氨基酸序列,这是猜测字母序列的一个显着的运用,离生成文本只要一步之遥。投资者和人工智能陈述的作者Nathan Benaich,在我最近与他的谈话中说到,他对最先进的分散模型怎样运用于生物和化学范畴感到兴奋。

本年是“从文本到全部”的一年,假如说从本年的惊人开展中能够学到什么的话,那便是文本作为一种“宣布指令”的前言,正变得愈加强壮。你不需求艺术训练,也不需求一套数字艺术软件或绘画东西,也能来把“漂浮的城市”这一主意变成视觉实际。你能够把它说出来或打出来,让它存在。

你将用你的文字创造什么?

来源:DeFi之道

作者:Daniel Bashir

转载请注明:AI 赋予文字无限力量:“由文本生成一切”的一年 | 币百度