WB3交流加微信:WX-93588,⬅️此处为全站广告位,与正文项目无关

注册并登录App即可领取高达 60,000 元的数字货币盲盒:点击此处注册OKX

图片来历:由无界版图AI工具生成

最近的谷歌像个大漏勺,这不,又有AIGC中心成员联手跑路咯!

量子位独家得悉,这回跟谷歌say byebye的,是文生图中心团队——AI绘画模型Imagen论文的四位中心作者,出走意图是要搞自己的AI公司。尽管公司名称暂未对外公布,但新公司将一以贯之的路线是很清楚的:

以Imagen为根底,沿着本来的项目做下去,不只持续做文生图,还要做视频方向。

中心人才创业,自然少不了VC塞钱——现已按1亿美元的惊人天使估值完结了首轮融资,并且更多VC想给钱而赶不上、投不进。

这也算是文生图、文生视频、AIGC赛道上,最知名的研讨团队之一了。

文生图骨干成员共创AIGC新公司

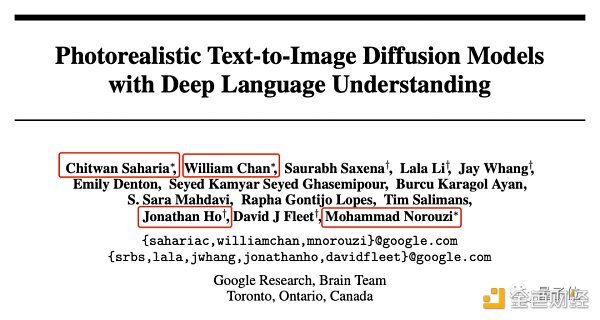

新公司联创四人,Chitwan Saharia、William Chan、Jonathan Ho以及Mohammad Norouzi,都出自谷歌。

他们之前精力重点放在AIGC的文生图板块,是谷歌用来对抗DALLE-2的大杀器Imagen的论文一起作者,方位都挺重要的那种。

先来介绍一下Chitwan Saharia,也是Imagen的一起一作。

Chitwan本科结业于孟买理工学院计算机科学与工程专业,在孟买理工学院和蒙特利尔大学都当过程序和算法方面的研讨助理。2019年参加谷歌,base多伦多,花了3年时刻从二级软件工程师做到高档研讨科学家,上一年12月从谷歌离任。

Chitwan有语音识别、机器翻译的经历,在谷歌作业时,首要担任领导image-to-image分散模型的作业。

第二位William Chan,也是Imagen论文一起一作。他相同身世计算机工程,先后就读于加拿大滑铁卢大学、卡内基梅隆大学,中间在新加坡国立大学当过1年交流生。

在卡内基梅隆大学拿下博士学位后,William还在加拿大最大的社区学院之一乔治布朗学院,主攻烘焙和烹饪(?),学了3年。

Willian从2012年起参加谷歌,于2016年成为谷歌大脑的一份子,上一年5月离任时,他现已是谷歌大脑多伦多的研讨科学家了。

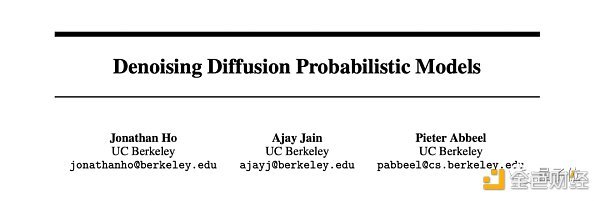

然后要介绍的是Jonathan Ho,UC伯克利博士结业。

他不只是Imagen论文的core contribution,仍是Diffusion Model奠基之作《Denoising Diffusion Probabilistic Models》的一作。

博士结业于UC伯克利计算机科学专业的Jonathan,之前在OpenAI当过1年的研讨科学家,后来在2019年参加谷歌,共作业了2年零8个月,上一年11月以研讨科学家的身份从谷歌离任。

新公司的最终一位联创叫Mohammad Norouzi,也是Imagen论文的一起一作。

△

他在多伦多大学计算机科学博士就读期间,拿到了谷歌ML博士奖学金。结业后他参加谷歌大脑,在那儿作业了7年,在谷歌的最终title是高档研讨科学家,作业重点是生成模型。

一起,Mohammad也是谷歌神经机器翻译团队的原始成员,SimCLR的联合发明人。他在GitHub主页上小小地泄漏了自己的最近动态:

这句话以外,关于新公司的更多信息,四人在任何社交平台都没有更详细的泄漏。

这现已是谷歌最近漏出去的第n波人了。

就拿刚刚过去的2个月来说,先是包含顾世翔(Shane Gu,‘让我们一步一步地思考’研讨者)在内的至少4名谷歌大脑成员参加OpenAI;情人节时,Hyung Won Chung和CoT最早的一作Jason Wei携手组团叛逃OpenAI。

本周三,您猜怎么着?嘿,又跑了一个:

OpenAI狂喜,只要谷歌大漏勺本勺受伤的国际诞生了。

Imagen是什么?

了解完谷歌漏走的这四个人,回头来说说为他们职业生涯赢得掌声的Imagen项目。

Imagen是谷歌发布的文生图模型,发布时刻在DALL-E 2新鲜出炉一个月今后。

本文最初放的熊猫震惊表情包,便是朝Imagen输入“一只非常快乐的毛茸熊猫装扮成了在厨房里做面团的厨师的高对比度画像,他身后的墙上还有一幅画了鲜花的画”后,得出的一张要素齐备的AI生成画作。(不好意思,请自行断句)

在Imagen呈现之前,文生图都共用一个套路,那便是CLIP担任从文本特征映射到图画特征,然后指导一个GAN或Diffusion Model生成图画。

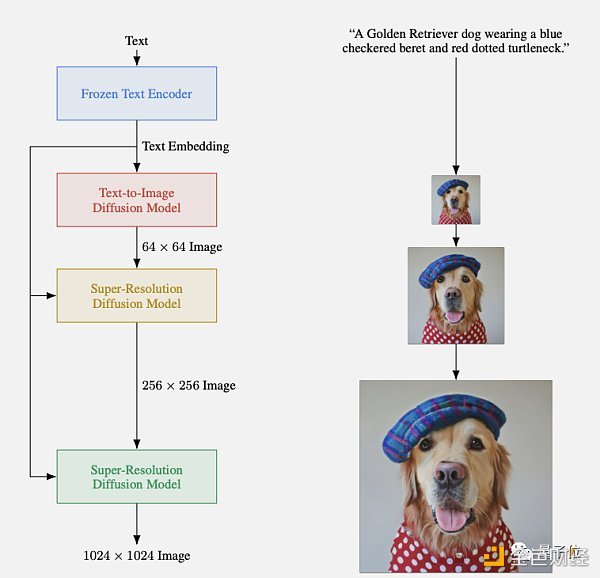

Imagen不走寻常路,开辟了text-to-image新范式:

纯言语模型只担任编码文本特征,具体text-to-image的作业,被Imagen丢给了图画生成模型。

具体来讲,Imagen包含一个冻结的言语模型T5-XXL(谷歌自家出品),当作文本编码器。T5-XXL的C4练习集包含800GB的纯文本语料,在文本了解能力上比CLIP强不少,由于后者只用有限图文对练习。

图画生成部分则用了一系列分散模型,先生成低分辨率图画,再逐级超采样。

依赖于新的采样技术,Imagen答应运用大的引导权重,所以不会像原有作业一样使样本质量下降。这么一来,图画具有更高的保真度,并且能更好地完结图画-文本对齐。

概念说起来简单,但Imagen的作用仍是令人大为震慑的。

生成的狗子飙车技术一流:

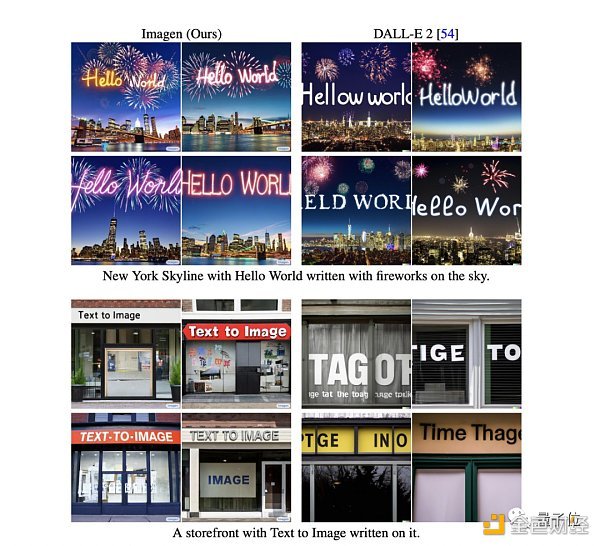

比起爆火的DALLE-2,Imagen能更准确地了解一起呈现两个色彩要求的情况:

一边绘画一边写字这种要求,Imagen也成功完结,不只写得对,还能加光影魔术手般的烟花特效(不是)。

以及对后来研讨更有协助的是,谷歌经过Imagen的研讨,优化了分散模型。

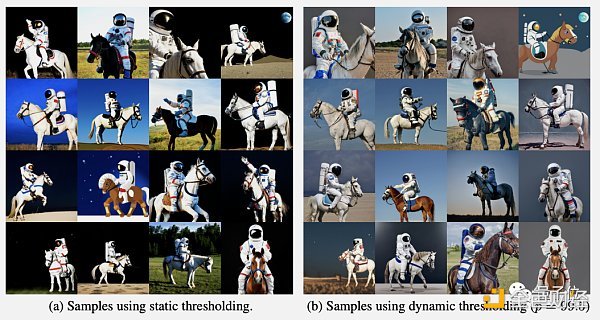

首要,添加无分类器引导(classifier-free guidance)的权重能够改进图文对齐,一起却会损害图画保真度。

为了解决这个bug,在每一步采样时引进动态阈值(dynamic thresholding)这个新的新的分散采样技术,来防止过饱和。

第二,运用高引导权重的一起在低分辨率图画上添加噪声,能够改进分散模型多样性不足的问题。

第三,对分散模型的经典结构U-Net做了改进,变成了Efficient U-Net。后者改进了内存运用功率、收敛速度和推理时刻。

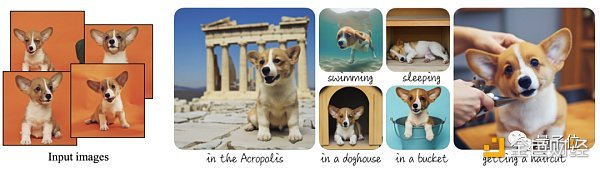

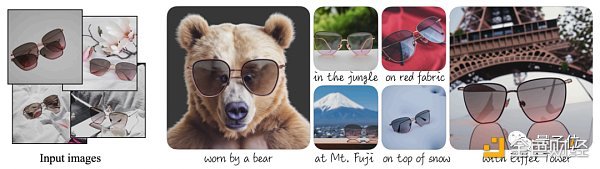

后来在Imagen上微调,谷歌还推出了能“指哪打哪”版别的文生图模型DreamBooth。只需上传3-5张指定物体的照片,再用文字描述想要生成的布景、动作或表情,就能让指定物体“闪现”到你想要的场景中。

比方酱婶儿的:

又或许酱婶儿的:

大概是Imagen作用过分超卓,劈柴哥后来亲自宣发的谷歌AI生成视频选手大将,就叫做“Imagen Video”,能生成1280*768分辨率、每秒24帧的视频片段。

啊,等等,谷歌有Imagen Vedio,这和四人的新公司不是撞方向了吗?

细心看了下论文,无论是Imagen仍是Imagen Video,各自都有大篇幅触及风险、社会影响力的内容。

出于安全、AI伦理和公平性等方面考虑,Imagen和Imagen Vedio都没有直接开源或敞开API,甚至连demo都没有。

哪怕市面上呈现开源复刻版别,也不是最正宗的滋味。

此前就曝出过在谷歌每年的内部员工查询“Googlegeist”中,员工表示对谷歌执行能力不佳的质疑。或许,这四人出走,持续做Imagen,并做Imagen的视频版,说不定便是为了想把项目放到一个更敞开的AI环境。

并且这种出走创业,也是热钱大钱向AIGC汹涌的成果。

所以既然AIGC的创投热潮现已在太平洋那头开启,那应该在太平洋这头也不会悄然无声。

或许你现已听说了一些相同的大厂出走创业,欢迎爆料说说~~

来历:“量子位”(ID:QbitAI),DeFi之道

作者:房屋

转载请注明:谷歌AI绘画4大牛携手创业 天使估值7个亿 | 币百度